27M小模型超越o3-mini-high和DeepSeek-R1!推理還不靠思維鏈。

開發者是那位拒絕了馬斯克、還要挑戰Transformer的00后清華校友,Sapient Intelligence的創始人王冠。

這個27M小模型就是Sapient最新提出的開源可復現的分層推理模型Hierarchical Reasoning Model(下面簡稱HRM),模仿大腦的分層處理與多時間尺度運作機制,克服了標準Transfomer的計算局限。

2700萬參數,就實現了對現有大模型的精準超車。

不用預訓練補課,還不靠思維鏈打草稿,僅憑1000個訓練樣本,就把極端數獨、30x30迷宮玩得明明白白。

甚至連衡量通用智能的ARC-AGI測試都能碾壓一眾參數規模更大、上下文更長的Claude 3.7等“大前輩”。

有網友感嘆,這就像四兩撥千斤AI版……

所以,HRM這個小模型是如何做到的?

核心是仿腦的雙層循環模塊設計

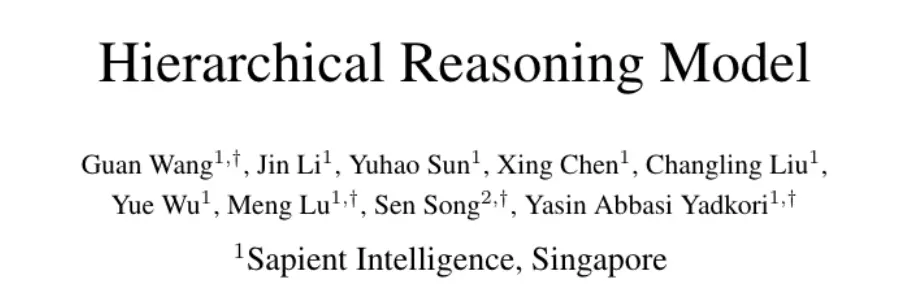

HRM之所以能有如此出色的表現,源于其五項核心技術的巧妙設計。

首先是分層循環模塊與時間尺度分離。

HRM受大腦皮層區域分層處理和時間分離機制啟發,設計了兩個相互配合的循環模塊:一個高層模塊負責慢節奏的抽象規劃,一個低層模塊處理快節奏的細節計算,不用明確監督中間過程,一次就能完成推理。

兩者在不同時間尺度上協同工作。低階模塊在每個高階周期內完成多次計算并達到臨時穩定狀態后,高階模塊才會更新決策,隨后低階模塊重置并開啟新一輪計算。

這種設計既保證了全局方向的正確性,又提升了局部執行的效率。

比如,在需要大量樹搜索和回溯的Sudoku-Extreme Full任務上,增加Transformer的寬度不能提升性能,增加深度才是關鍵,而標準架構會出現性能飽和,無法從深度增加中獲益。

HRM則克服了這一限制,能有效利用計算深度實現近乎完美的準確率。

其次是分層收斂機制。

普通的循環神經網絡常出現過早收斂的問題——計算幾步就陷入穩定狀態,后續再復雜的任務也無法推進。

而HRM中,低階模塊在每輪計算中會收斂到基于當前高階狀態的局部結果,但高階模塊更新后,會給低階模塊設定新的目標,使其進入新的收斂周期。

這就像完成項目時,先攻克一個子任務,再根據整體進度調整目標,確保持續推進不偷懶。

第三項是近似梯度技術。

傳統循環模型訓練時,需要存儲所有中間狀態并反向追溯,類似復盤時要回看每一步操作,既耗內存又低效。

HRM則采用一步梯度近似,只需根據最終狀態反推優化方向,如同根據考試結果直接定位薄弱知識點,內存需求恒定且計算高效,更符合生物大腦的學習規律。

第四是深度監督機制。

它受大腦中神經振蕩調節學習節奏的啟發,引入了階段性測試。

模型在學習過程中被分成多個階段,每個階段結束后立即評估并調整參數,且前后階段的計算互不干擾。

這種方式能及時糾正偏差,就像學生每學一單元就測試鞏固,比期末一次性考試的學習效果更扎實。

自適應計算時間讓HRM能像人一樣靈活分配思考時間。

它通過類似評估收益的算法(Q學習),動態決定是否繼續計算,在保證準確率的同時避免算力浪費,推理時還能通過增加計算資源進一步提升表現。

比如,簡單任務如簡單迷宮快速給出答案,復雜任務如高難度數獨則延長計算時間。

這些技術的融合,讓HRM在多項測試中表現不凡。

下圖通過可視化中間步驟,驗證了HRM的分層推理機制能夠有效拆解復雜任務,通過漸進式計算逼近正確結果,而非依賴黑箱式的一次性輸出。

在衡量AI通用推理能力的ARC-AGI挑戰中,HRM僅用2700萬參數和1000個訓練樣本,就達到40.3%的準確率,超過了參數規模更大的o3-mini-high(34.5%)和Claude 3.7 8K(21.2%)。

對于需要反復試錯的9x9極端數獨,現有思維鏈模型完全無法解決(準確率0%),即便是結構相似的Transformer模型,用同樣數據訓練也毫無頭緒。而HRM幾乎能全部做對。

在30x30復雜迷宮的最優路徑尋找任務中,HRM表現穩定,而1.75億參數的大型Transformer模型準確率不足20%。

雖然,HRM被指參數太小、訓練范圍有限,只針對特定領域表現好,無法泛化到領域外,并不通用。但有人認為小而精的模型或許在某些角度上更智能。

人工智能的飛躍在于創造性。

也有人認為HRM的前景更在于“仿腦”,通過精心設計的高低兩個模塊避免過早收斂,對過擬合具有極強的抵抗力。

甚至有人相當樂觀,認為這種新架構是神經網絡一個巨大的進步。有可能是超越Transformer的時刻。

拒絕馬斯克,挑戰Transfomer

論文的第一作者王冠是一位00后,8歲開始學習編程,后保送至清華大學計算機系。

他是GitHub攬星5.1k開源項目OpenChat的獨立開發者,獨立完成了OpenChat全部版本的模型開發和訓練框架搭建。

也正是因為OpenChat這個項目,他和馬斯克產生了交集。

但他算得上是一個拒絕了馬斯克的男人——此前,王冠多次拒絕了xAI等一線機構創始人的加入邀請。

原因是他認為自己要做的是顛覆Transfomer。

2024年,王冠和聯合創始人Austin創辦了Sapient Intelligence,并成功融資數千萬美元。致力于打造“真正具有復雜推理和規劃能力的全新大模型架構”。